Le biais du connaisseur

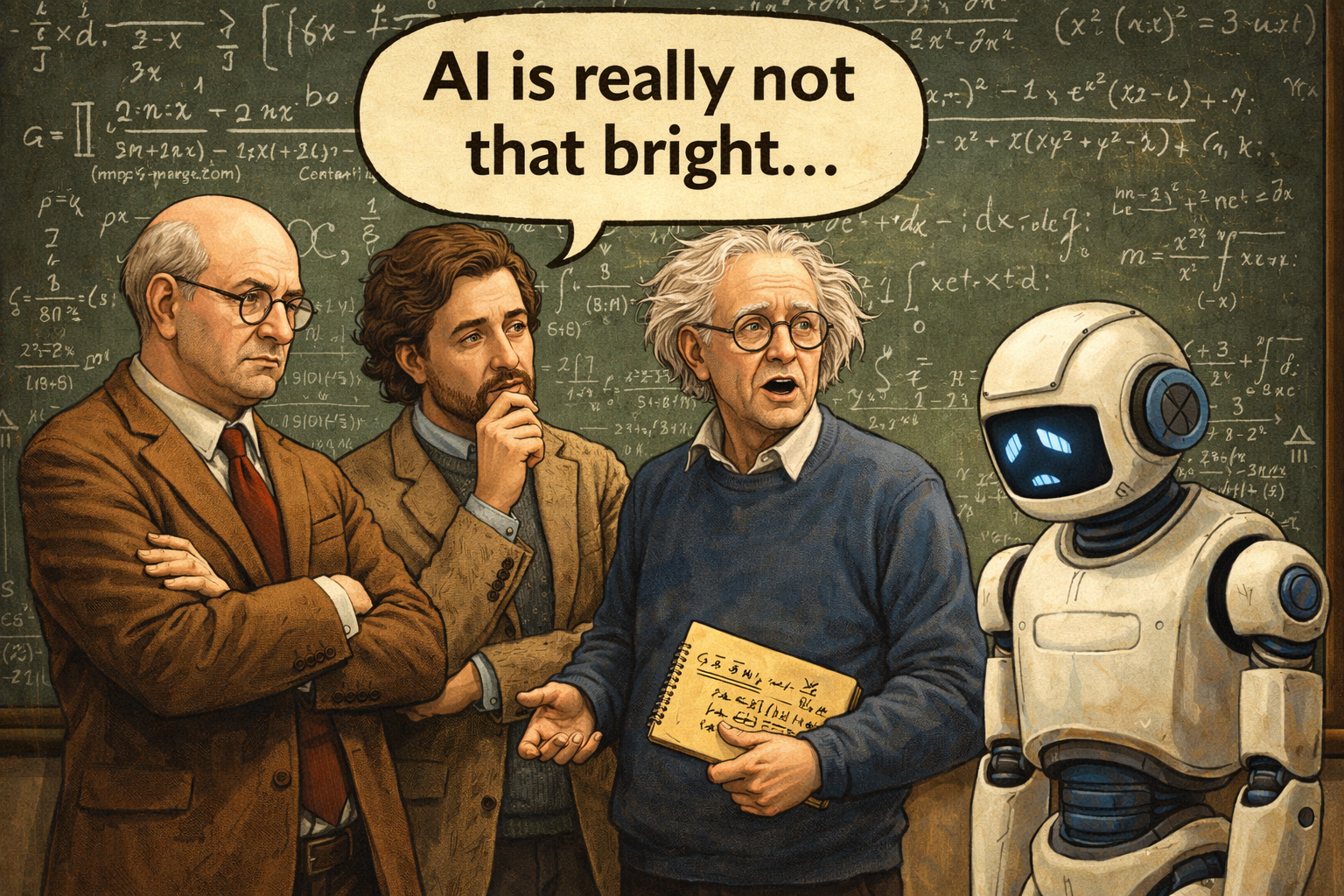

Il y a quelque chose de cocasse dans la façon dont certains “experts” considèrent l’IA générative. Un joueur d’échecs voit ChatGPT jouer un coup illégal et conclut, satisfait, que les LLM ne comprennent rien aux échecs. Un mathématicien trouve une erreur de calcul élémentaire et décrète que ces modèles ne raisonnent pas vraiment. Ces verdicts ont en commun une même structure : ils jugent depuis l’intérieur d’une compétence, là précisément où l’écart se voit le mieux.

Il y a quelque chose de cocasse dans la façon dont certains “experts” considèrent l’IA générative. Un joueur d’échecs voit ChatGPT jouer un coup illégal et conclut, satisfait, que les LLM ne comprennent rien aux échecs. Un mathématicien trouve une erreur de calcul élémentaire et décrète que ces modèles ne raisonnent pas vraiment. Ces verdicts ont en commun une même structure : ils jugent depuis l’intérieur d’une compétence, là précisément où l’écart se voit le mieux.

Monsieur Phi a consacré une vidéo fascinante à cette question des LLM et des échecs. Pendant longtemps, l’expérience standard consistait à demander à ChatGPT de jouer aux échecs, à le regarder commettre des coups illégaux, et à en tirer la conclusion que les modèles de langage sont fondamentalement incapables de comprendre un jeu à règles strictes. Puis un certain GrandSlaton a essayé de fournir au modèle l’en-tête d’un fichier PGN — le format standard utilisé pour archiver les parties — présentant une rencontre entre Magnus Carlsen et Nepomniachtchi, et a laissé le modèle jouer les parties. GPT-3.5 turbo instruct a alors joué à un niveau autour de 1800 Elo, soit nettement au-dessus de l’écrasante majorité des joueurs humains, avec seulement 0,04 % de coups illégaux1.

Cette confusion entre ne réussit pas dans cette configuration et est fondamentalement incapable revient comme un leitmotiv dans les critiques expertes de l’IA. Dans le domaine des mathématiques, Terence Tao — l’un des mathématiciens les plus brillants en activité — a décrit comment les LLM commettent des erreurs arithmétiques basiques, comment leur fiabilité reste insuffisante pour travailler seuls sur des preuves, et pourquoi les mathématiciens ne peuvent pas simplement leur faire confiance. Tout cela est juste. Mais Tao décrit aussi quelque chose que beaucoup de ses collègues sceptiques négligent : il a lancé l’Equational Theories Project : 22 millions de problèmes d’algèbre universelle résolus en moins de deux mois, avec une cinquantaine de collaborateurs dont la plupart n’étaient pas professionnels, grâce à une combinaison de prouveurs automatiques, de vérification formelle en Lean et de plateformes collaboratives ouvertes. Ce qui était impraticable faute de monde pour le faire est devenu faisable.

Le domaine de la programmation est peut-être celui où l’effet est devenu si massif qu’il a rendu le scepticisme difficile à maintenir. Andrej Karpathy raconte, dans une conversation récente, qu’en décembre dernier quelque chose a basculé pour lui : il est passé d’écrire lui-même 80 % de son code à en déléguer plus de 80 % à des agents. Il coordonne plusieurs agents en parallèle, comme un chef de projet qui distribue des tâches à une équipe. Il parle lui-même d’“AI psychosis” pour décrire l’état d’adaptation permanente à des capacités qui progressent plus vite qu’on ne peut les assimiler. Ce qui est frappant dans son témoignage, c’est qu’il ne se demande plus si les agents fonctionnent, mais cherche comment les utiliser mieux. Le questionnement s’est déplacé de la légitimité de l’outil à la maîtrise de son usage.

Toutes les critiques ne sont pas infondées. La fiabilité des LLM reste un problème réel, leur tendance à confabuler avec assurance mérite d’être prise au sérieux, et Karpathy lui-même reconnaît que les agents font parfois des choses absurdes. Critiquer un outil pour mieux le comprendre est une chose. Critiquer pour ne pas regarder ce qui change en est une autre — et cette posture, consciente ou non, ressemble à de la défense de territoire. L’expert moquant l’erreur de l’IA protège l’idée que son champ de compétence restera durablement hors de portée.

Footnotes

l’échec à une tâche avec un certain prompt ne prouve que l’échec avec ce prompt. L’espace des prompts possibles est quasiment infini, et les capacités d’un modèle peuvent rester entièrement invisibles si on ne sait pas les invoquer.↩︎